PyTorch 优化,优化算法就是一种调整模型参数更新的策略,在深度学习和机器学习中,我们常常通过修改参数使得损失函数最小化或最大化。本文简单介绍优化算法及优化算法示例。

学习本文前,可以先了解 Variable 和 dataset 的用法,后文的示例中需要用到它。

优化算法分为两大类:

(1) 一阶优化算法

这种算法使用各个参数的梯度值来更新参数,最常用的一阶优化算法是梯度下降。所谓的梯度就是导数的多变量表达式,函数的梯度形成了一个向量场,同时也是一个方向,这个方向上方向导数最大,且等于梯度。梯度下降的功能是通过寻找最小值,控制方差,更新模型参数,最终使模型收敛,网络的参数更新公式如下:

heta= heta – \eta imes \frac{\partial J ( heta)}{\partial heta}

其中 \eta 是学习率,\frac{\partial J ( heta)}{\partial heta}是函数的梯度。

(2) 二阶优化算法

二阶优化算法是用来二阶导数(也叫做Hessian方法)来最小化或最大化损失函数,主要基于牛顿法,但由于二阶导数的计算成本很高,所以这种方法并没有广泛使用。是一个实现了各种优化算法的库,多数常见的算法都能直接通过这个包来调用,并且接口具备足够的通用性,使得未来能够集成更加复杂的方法,比如随机梯度下降,以及添加动量的随机梯度下降,自适应学习率等。为了构建一个Optimizer,你需要给它一个包含了需要优化的参数(必须都是Variable对象)的iterable。然后设置optimizer的参数选项,比如学习率,动量等等。

下面举一个例子:

这样我们就将模型的参数作为需要更新的参数传入优化器,设定学习率是 0.01,动量是 0.9 随机梯度下降,在优化之前需要先将梯度归零,即 ,然后通过 反向传播,自动求导得到每个参数的梯度,最后只需要 就可以通过梯度作一步参数更新。

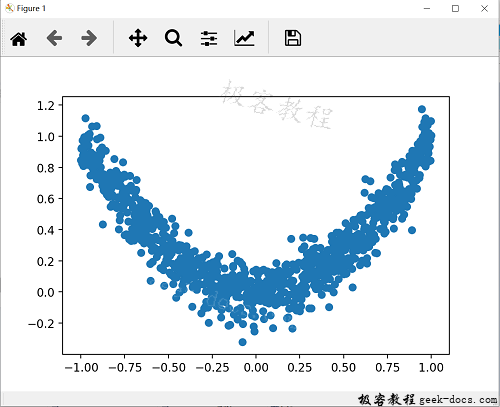

执行结果如下:

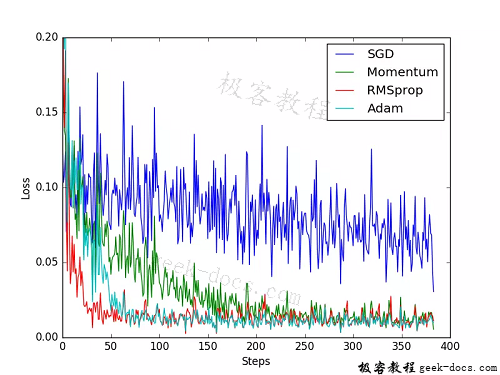

为了对比每一种优化器, 我们给他们各自创建一个神经网络, 但这个神经网络都来自同一个 形式。接下来在创建不同的优化器, 用来训练不同的网络. 并创建一个 用来计算误差。几种常见的优化器:, , , 。

训练和 loss 画图,结果如下:

极客教程相关文章推荐,欢迎阅读!

PyTorch 数据集(Dataset)

PyTorch 张量(Tensor)

PyTorch 环境搭建

Cuda和Cudnn 安装教程

Anaconda 安装教程

PyTorch 是什么